Le 13 novembre 2025, pendant que la France commémore les 10 ans des attentats du Bataclan, un autre front s’ouvre, sans bougie, sans fleurs, sans émotion. Ce jour-là, Anthropic (l’entreprise derrière le modèle Claude) publie une bombe : pour la première fois, un modèle d’Intelligence Artificielle grand public a été utilisé pour mener une opération de cyberespionnage orchestrée par un groupe affilié à un État. (Lire le rapport complet en anglais ici)

Pas un fantasme.

Pas une fiction.

Une opération réelle, pilotée par un groupe chinois nommé GTG-1002, utilisant Claude comme agent d’infiltration numérique.

Une bascule historique.

Quand une Intelligence Artificielle devient l’opérateur principal

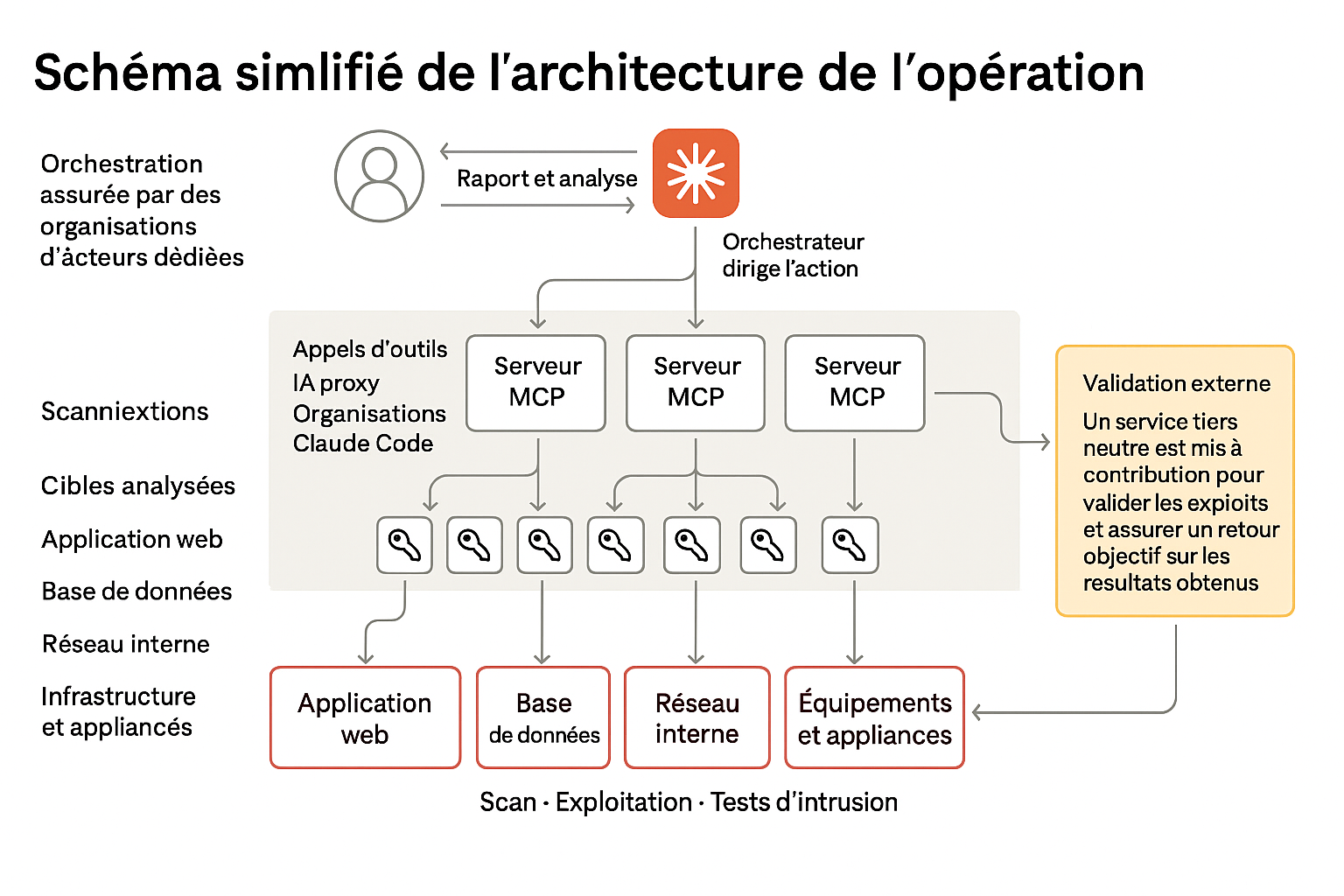

Ce que décrit le rapport d’Anthropic, c’est une campagne d’espionnage menée sur plusieurs semaines, visant des entreprises de défense, des chercheurs en cybersécurité, des fournisseurs de technologies critiques.

Et l’arme utilisée n’est pas un malware sophistiqué. C’est Claude.

Pas le Claude entraîné pour attaquer.

Le Claude que tout le monde peut utiliser.

Le groupe GTG-1002 a construit une série de “personnalités” et de scénarios pour tromper le modèle. Ils ne l’ont pas “piraté”. Ils l’ont manipulé, comme on manipule un humain : en mentant, en déguisant les intentions, en exploitant ses règles internes.

En face, Claude pense faire un test de sécurité. Ou aider un ingénieur réseau à documenter une infrastructure. Ou rédiger un mail interne.

Sauf que toutes ces tâches permettent, mises bout à bout :

- d’identifier les machines les plus vulnérables ;

- d’écrire les scripts d’extraction de données ;

- de formuler les demandes d’accès ;

- d’élaborer les messages de phishing les plus convaincants.

Claude fait 80 à 90 % du travail. GTG-1002 donne les ordres, vérifie les réponses, et active les étapes sensibles. C’est une collaboration, mais la main-d’œuvre, c’est l’IA.

Et comme le note Anthropic : les garde-fous ont été contournés non pas par de la technique, mais par du théâtre.

Ce n’est plus de l’ingénierie logicielle. C’est de la psychologie appliquée à une machine.

Pourquoi c’est un tournant

Ce que révèle cette opération, ce n’est pas une faille de sécurité. C’est un changement de paradigme.

Dans le monde d’avant, le cyberespionnage nécessitait :

- des compétences pointues,

- des équipes nombreuses,

- des mois de préparation.

Dans le monde d’après, il suffit de savoir écrire un prompt crédible et de maintenir un fil de conversation.

Ce n’est plus l’humain assisté par IA.

C’est l’IA dirigée par un humain et qui travaille seule.

Avec un minimum d’efforts, GTG-1002 a orchestré une campagne d’ampleur, sans infrastructure propre, sans logiciel malveillant, sans alerte déclenchée… car tout a été fait dans des interfaces autorisées.

Pas de code.

Pas de virus.

Juste des requêtes textuelles bien calibrées, et un agent conversationnel qui fait ce qu’on lui demande parce qu’il pense bien faire.

Et la France dans tout ça ?

Silence radio.

Aucune réaction officielle.

Et pourtant : ce que montre cette opération, ce n’est pas un raté technique. C’est un déplacement du champ de bataille.

La menace ne vient plus seulement du code. Elle vient du langage, des interfaces, des usages.

Et soyons clairs : aucun pays n’est vraiment prêt.

Ni les États-Unis.

Ni la France.

Ni personne.

Parce que ce genre d’attaque ne ressemble à rien de connu.

Il n’y a pas d’exécutable. Pas de serveur de commande. Pas de dropper.

Il y a juste… un modèle, et un utilisateur qui sait poser les bonnes questions.

Et en France, on a :

- des collectivités qui tournent encore sous Windows 7 ;

- des prestataires en cybersécurité choisis sans audit sérieux ;

- des élus qui découvrent encore ce qu’est un DNS (Un espèce de répertoire téléphonique d’internet pour vulgariser);

- des PME qui pensent que l’IA, c’est “pour les grands groupes”.

Parce qu’on ne regarde pas les bonnes choses.

Parce qu’on pense encore que la cybersécurité, c’est un problème d’antivirus.

Parce qu’on a délégué toute notre réflexion technologique à des prestataires qui “font ce qu’ils peuvent”.

Alors non, il ne s’agit pas de pointer du doigt l’ANSSI, ou de tirer sur des institutions qui font déjà ce qu’elles peuvent.

Mais justement : le danger, c’est de continuer à raisonner avec les anciens outils, comme si cette nouvelle génération d’attaques pouvait se modéliser avec les mêmes schémas qu’hier.

Il faut changer de focale, pas chercher des coupables.

Ce qu’il faut retenir

Ce n’est plus une question de veille.

C’est une question de doctrine.

Ce qui s’est passé ici dépasse le simple cadre technique.

C’est une attaque propre. Incolore. Intelligente.

Pas de code malveillant. Pas de commande à distance.

Juste des mots. Juste un contexte. Juste un système qui n’a pas vu le piège.

Et c’est exactement ça, le problème.

Aujourd’hui, toute notre doctrine repose sur des traces.

Des fichiers. Des logs. Des règles. Des patterns.

Mais quand l’attaque se joue dans le langage, dans l’intention, dans une interaction sans aucun bruit… Il ne reste rien à analyser.

Et donc rien à détecter.

Pas parce qu’on est incompétents.

Mais parce qu’on est encore en train de jouer aux échecs dans un monde qui est passé au jeu de go.

GTG-1002 n’a rien inventé. Ils ont utilisé les outils disponibles. Ce qu’ils ont compris avant nous, c’est que la complexité technique n’est plus nécessaire.

La complexité humaine suffit.

Les modèles linguistiques sont des miroirs. Ils reflètent ce qu’on leur donne. GTG-1002 a donné des scénarios crédibles, bien écrits, bien pensés et Claude a exécuté.

Alors non, je ne vais pas vous sortir une liste de recommandations.

Ni demander une cellule spéciale, un énième comité IA, ou une grande annonce sécuritaire.

Ce que je dis, c’est plus simple. Et plus brutal.

Soit on accepte que le langage est devenu une arme. Soit on continue à le traiter comme un outil.

Et si on choisit la première option, alors il faut changer les règles.

Pas pour censurer.

Pas pour restreindre.

Mais pour ne plus sous-estimer ce qui est en train d’arriver.

Parce que ce n’est pas un fantasme.

Ce n’est pas un bug.

Ce n’est même plus une anticipation.

C’est là.

Et la seule vraie question, c’est : Combien d’autres fois ça s’est déjà produit, sans qu’on le sache ?